L’informazione, in ogni epoca, non è mai stata un semplice specchio neutrale della realtà.

È piuttosto un filtro: seleziona, organizza e interpreta i fatti, inevitabilmente influenzata da

interessi, contesti culturali e strumenti tecnologici. Anche quando non esiste un’intenzione

esplicita di ingannare, il modo in cui una notizia viene raccontata contribuisce a costruire

una certa visione del mondo. Con l’evoluzione dei media, questo processo si è amplificato,

dunque la linea tra informazione, interpretazione e manipolazione è diventata sempre più

sottile. Un aspetto particolarmente rilevante della contemporaneità è la crescente

sofisticazione dei contenuti ingannevoli: non si tratta più soltanto di notizie completamente

inventate, ma di materiali ibridi che mescolano elementi autentici e alterati in modo quasi

impercettibile. Tecnologie come l’IA generativa permettono di creare testi, immagini e video

estremamente realistici, ma anche di intervenire su contenuti reali modificandoli in modo

mirato. Questo rende sempre più difficile distinguere il vero dal falso, soprattutto quando le

manipolazioni sono essenziali e strategiche.

In questo scenario, la disinformazione non consiste solo nel diffondere il falso, ma anche

nel creare incertezza e nel moltiplicare le versioni dei fatti. È proprio su questa base che, in

contesti più delicati come quelli politici o bellici, la manipolazione dell’informazione trova

terreno fertile e assume un ruolo ancora più incisivo, perché controllare il racconto significa

spesso controllare anche il consenso. Già durante la Prima e la Seconda Guerra Mondiale,

governi e apparati militari producevano immagini, notizie e racconti selezionati o alterati per

rafforzare il morale interno e demonizzare il nemico.

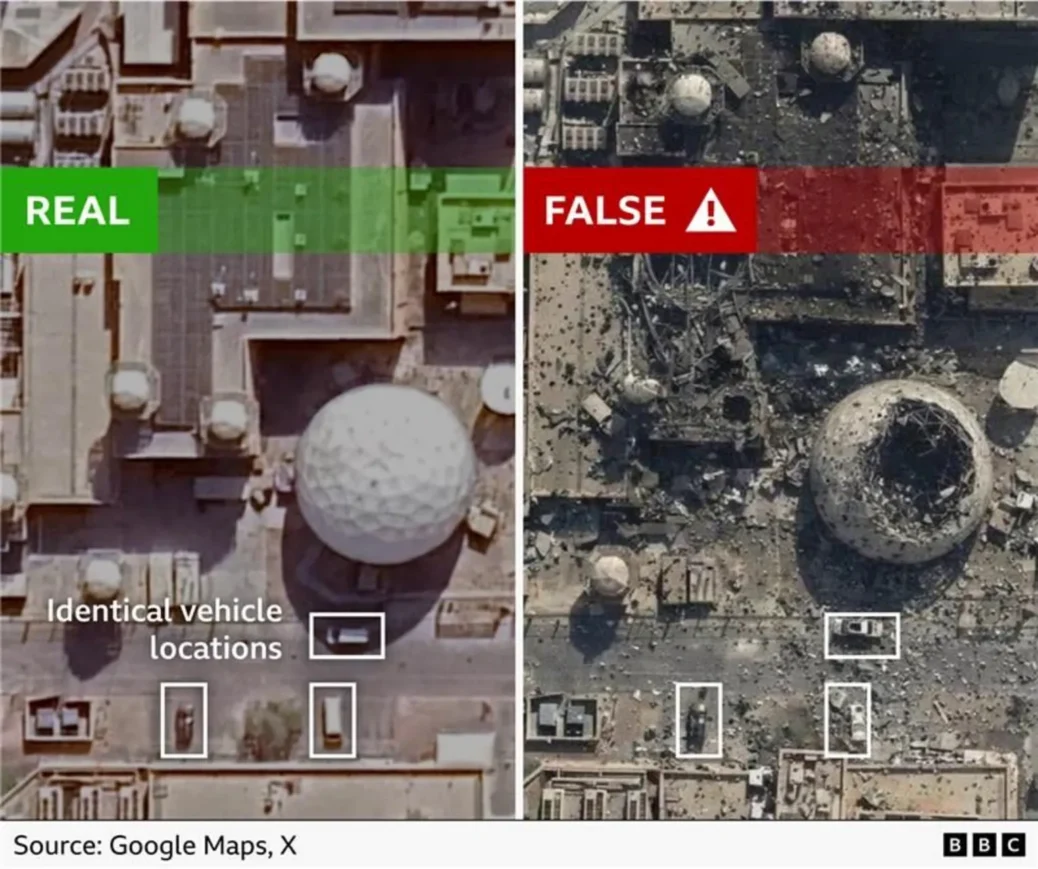

Una foto satellitare reale, ad esempio, può essere leggermente modificata tramite sistemi

di IA, aggiungendo elementi plausibili (veicoli, danni, infrastrutture) oppure rimuovendo

dettagli scomodi. Ancora, grazie a tecnologie avanzate, è possibile far dire a leader politici

cose mai pronunciate, oppure immagini o video reali, ripresi in altri momenti o luoghi,

possono essere riproposti come se fossero attuali.

Diverse inchieste condotte da BBC Financial Times, AFP e NewsGuard hanno

smascherato una serie di immagini satellitari e video realizzati con l’AI che hanno inquinato

il racconto del conflitto tra Iran, Israele e Stati Uniti.

Uno degli esempi più citati dai giornali internazionali, tra cui The Hindu e Chosun Ilbo,

riguarda un post pubblicato su X dal Tehran Times, un quotidiano vicino al governo

iraniano. Il post mostrava un “prima e dopo” della base aerea di Al Udeid in Qatar,

sostenendo che i radar statunitensi fossero stati completamente distrutti da un attacco di

droni. L’analisi forense di BBC Verify ha rivelato che l’immagine di partenza era uno scatto

reale di Google Earth del 2025. L’AI era stata istruita per aggiungere crateri e fumo nero

sugli edifici.

Un altro esempio documentato da CBS News riguarda il famigerato carcere di Evin a

Teheran. Pochi minuti dopo un attacco israeliano, ha iniziato a circolare su X un video in

bianco e nero, simile a una ripresa di una telecamera di sorveglianza, che mostrava una

massiccia esplosione all’ingresso della struttura. Esperti dell’Università di Berkeley hanno

confermato che si trattava di un video generato con strumenti Image-to-Video. I segnali del

falso erano sottili ma inequivocabili: l’insegna sopra la porta conteneva caratteri senza

senso e la dinamica del fumo non seguiva le leggi della fisica.

NewsGuard ha segnalato un’immagine, circolata su account pro-Iran, che mostrava

l’ambasciata americana a Riad, in Arabia Saudita, avvolta dalle fiamme dopo un presunto

attacco missilistico. Anche in questo caso, l’immagine era un prodotto artificiale.

Nonostante la drammaticità dello scatto, nessuna agenzia di stampa sul campo aveva

riportato l’evento. La particolarità di questo falso era l’uso di filtri per simulare la bassa

risoluzione delle foto scattate dai passanti, un trucco per nascondere le imperfezioni

dell’intelligenza artificiale e renderla più “autentica” agli occhi di un utente che scorre

velocemente il feed dei social.

In questo senso, la disinformazione moderna non mira solo a imporre una versione dei fatti,

ma a intaccare la fiducia stessa nella possibilità di conoscere la verità. La conseguenza più

profonda è culturale: se ogni fonte può essere sospetta, il rischio è un relativismo

informativo in cui tutto vale quanto il suo contrario.

È proprio in questa incertezza che la propaganda riesce a diffondersi più facilmente.