Come difendersi dallo strapotere dell’AI? Se è (forse)possibile distinguere una foto falsa da una vera, come stabilire se ciò...

Il Quotidiano in Classe: Perché le immagini satellitari della guerra in Iran modificate con l’Ai sono così convincenti?

La cronaca non si misura più solo con il rumore delle esplosioni, ma con la qualità dei pixel che le documentano. Negli ultimi mesi, la guerra tra Israele, Stati Uniti e Iran è diventata il primo vero conflitto in cui le immagini satellitari manipolate dall’intelligenza artificiale hanno raggiunto un livello di sofisticazione tale da ingannare non solo gli utenti comuni, ma persino gli algoritmi di ricerca più avanzati.

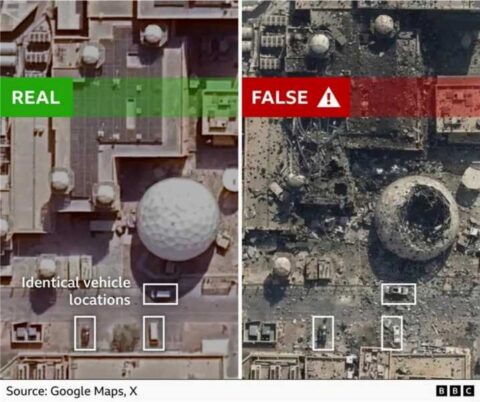

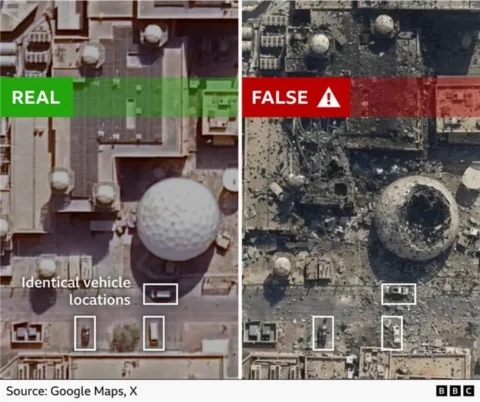

Diverse inchieste condotte da BBC Financial Times, AFP e NewsGuard hanno smascherato una serie di immagini satellitari e video realizzati con l’Ai che hanno inquinato il racconto del conflitto tra Iran, Israele e Stati Uniti. Ecco i casi più eclatanti e i meccanismi che li hanno resi virali. Perché i satelliti AI sono così convincenti

Le immagini satellitari “ritoccate” non sono semplici fotomontaggi. Gli attori della disinformazione utilizzano tecniche di Image-to-Image translation, dove partono da una base reale — ad esempio una foto di Google Earth di una base militare — e chiedono all’AI di “sovrapporre” i danni. Il risultato è una texture di distruzione, crateri e fumo che rispetta perfettamente l’illuminazione, le ombre e la prospettiva dell’immagine originale. Come riportato da testate come The Hindu e analisti di AFP, la difficoltà nel distinguerle nasce dal fatto che l’AI non inventa l’intera scena, ma altera solo i dettagli critici, mantenendo inalterato tutto il resto del contesto geografico.

La realtà sotto filtro

, , Perché le immagini satellitari della guerra in Iran modificate con l’Ai sono così convincenti?, 0L’informazione, in ogni epoca, non è mai stata un semplice specchio neutrale della realtà. È piuttosto un filtro: seleziona,...

L’IA è sempre più convincente

, , Perché le immagini satellitari della guerra in Iran modificate con l’Ai sono così convincenti?, 0L’articolo affronta un tema attualissimo con un taglio che riesce a essere insieme accessibile e inquietante: la trasformazione della...

Articoli recenti

Articoli con più Like

-

L’era delle culle glaciali +118

L’era delle culle glaciali +118 -

Tutti online ma disconnessi +116

Tutti online ma disconnessi +116 -

Euro Digitale: verso una nuova era +76

Euro Digitale: verso una nuova era +76 -

Donne e lavoro +74

Donne e lavoro +74 -

Generazioni sui Social +65

Generazioni sui Social +65 -

Cop29: un fallimento per il futuro +47

Cop29: un fallimento per il futuro +47 -

Il lavoro dei sogni: una grande sfida +44

Il lavoro dei sogni: una grande sfida +44 -

Un fantasma del passato che vive nel presente +44

Un fantasma del passato che vive nel presente +44 -

Quando l'app meteo non è più affidabile +41

Quando l'app meteo non è più affidabile +41 -

L’Ilva: necessità o dipendenza? +31

L’Ilva: necessità o dipendenza? +31